STOP ! On arrête tout ! Prenez 5mn pour former votre esprit critique.

Vous le savez déjà, l’IA amplifie les phénomènes de désinformation. Mais elle impacte aussi comment nous vérifions spontanément l’information. De plus en plus de gens délèguent à ce type d’outils la vérification d’informations par flemme, par manque de connaissances sur les limites de l’IA ou bien parce qu’ils ne savant pas comment faire autrement.

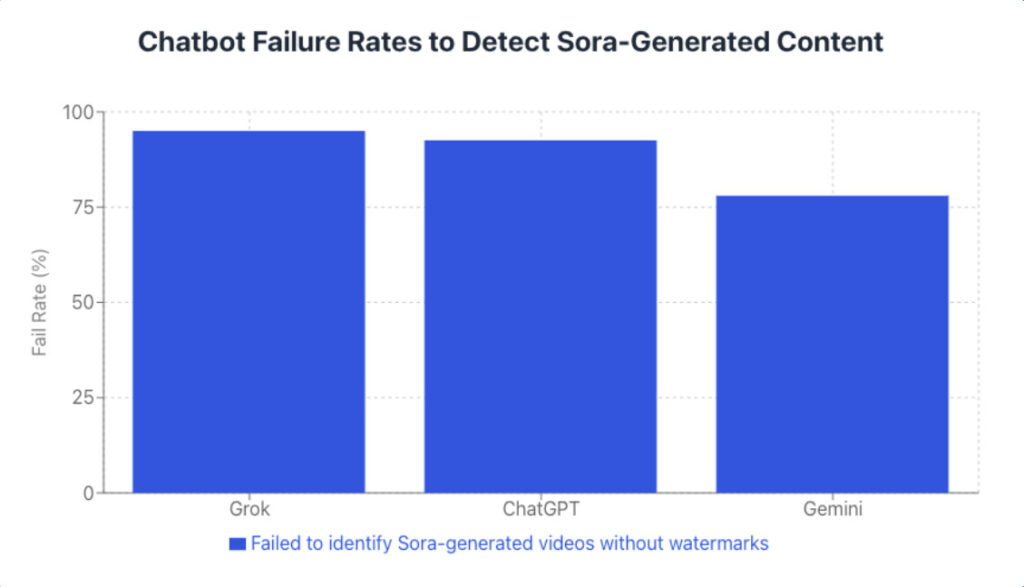

Un rapport récent de NewsGuard a testé l’efficacité d’IA pour détecter des vidéos générées par Sora (IA vidéo de OpenIA). Résultats : ❌ Grok : 95% d’échec ❌ ChatGPT : 92.5% d’échec ❌ Gemini : 78% d’échec.

Source : Rapport NewsGuard 2026 « AI Fools Itself : Top Chatbots Don’t Recognize AI-Generated Videos

Même si je reste dubitatif sur la méthodologie de ce test (pour m’être prêté à l’exercice), pour moi la conclusion n’est pas de ne pas utiliser ce type d’outils du tout. C’est plus nuancé.

Je vous propose d’explorer ici deux cas d’usage pour voir comment bien articuler l’utilisation d’une IA pour bien s’informer. Dans le document partagé en bas de l’article, vous trouverez des captures écrans pour documenter les différents outils que je vous recommande et que j’ai utilisé sur une des vidéos testés dans le rapport NewsGuard.

Pour aller plus loin et voir comment debunker de A à Z des info, je vous conseille l’excellent article pédagogique de C’est vrai ça ? .

Cas pratique #1 : Comment savoir si une vidéo/image est générée par IA ?

En théorie, une vidéo Sora a un logo qui défile de gauche à droite. Sur Veo (Google), il est en bas à droite. Le problème ? Il existe des outils gratuits pour gommer ces logos en deux clics. Les désinformateurs ne s’en privent pas. D’ailleurs, le rapport NewsGuard montre qu’une fois le logo effacé, même ChatGPT a du mal à identifier une vidéo Sora.

La bonne stratégie : L’IA comme guidage pour l’analyse

Plutôt que de demander à l’outil de vous dire si la vidéo a été généré par IA, demander à être aider dans l’identification d’indices et d’anomalies visuelles qui échappent à l’œil humain. Par exemple, la déformation des mains, les ombres et lumières incohérentes, les textes illisibles, les problèmes de superposition d’objets. Ca ne veut pas dire que ça sera toujours pertinent mais cela peut aider.

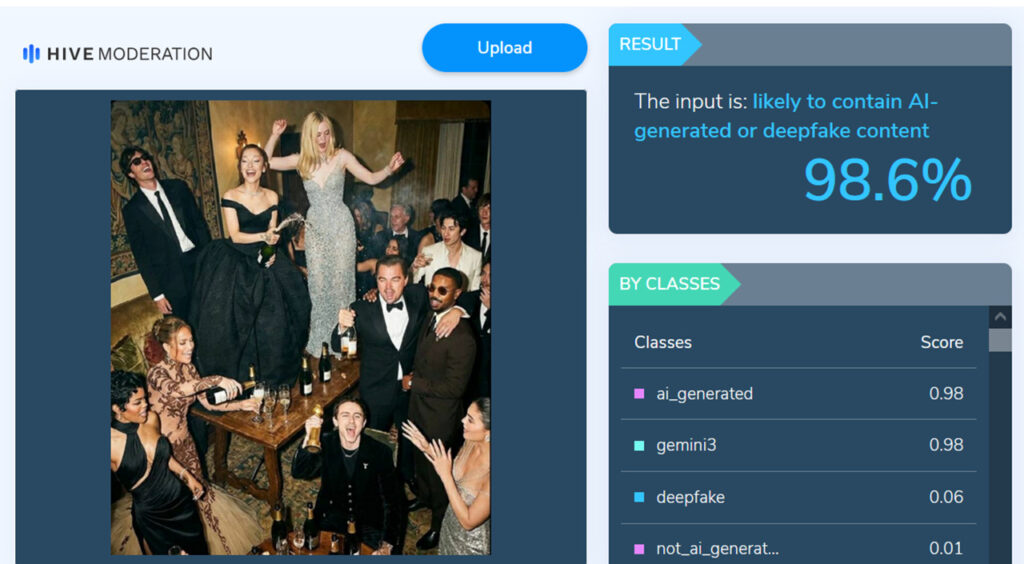

L’outil Must-Have : Hive Moderation, c’est gratuit, ça marche bien. :

Ma méthode :

- Faites des captures d’écran à différents moments de la vidéo suspecte.

- Importez-les dans Hive.

- L’outil vous donne un % de probabilité que ce soit de l’IA.

Pour le moment, je n’ai eu que 2 erreurs d’identification cet outil. Même s’il semble assez fiable, je recommande de recouper les infos en utilisant au moins une autre méthode en plus de cet outil.

Cas pratique #2 : Vérifier une info

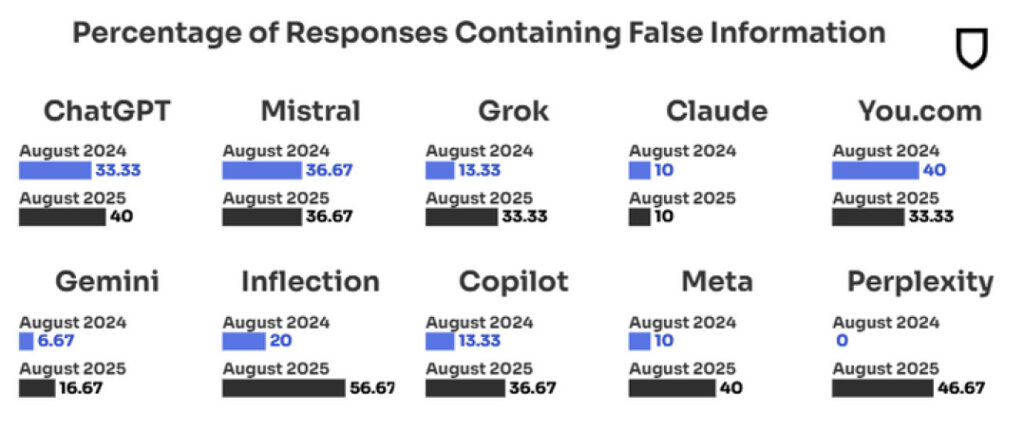

Soyons clairs : confier la vérification d’une info à l’IA est une mauvaise idée. Pour moi, le mauvais usage c’est de confier à l’IA la vérification d’une information. Le rapport NewsGuard 2025 montre que toutes les 10 IA les plus utilisés se trompent trop souvent pour qu’on puisse pas les considérer comme de bonnes sources d’informations. Par exemple, ChatGPT obtenait :

Rapport NewsGuard 2025 « AI False Information Rate Nearly Doubles in One Year »

- 33.33% de réponses contenant des informations fausses en 2024 contre 40% en 2025.

- Gemini obtenait lui 6.67% en 2024 contre 16.67% en 2025.

En aucune cas, une IA ne peut être votre source d’informations, par contre elle peut vous aider à structurer l’info et à gagner du temps pour trouver d’autres sources fiables.

Disponible sur Whatsapp, cet outil se base uniquement sur des sites fiables contrairement à d’autres IA qui peuvent compiler sans souci des informations provenant de sites de désinformation.

L’outil qui va faire grincer des dents : Perplexity

Je vais certainement provoquer des descentes d’organes, mais je conseille Perplexity… alors même que NewsGuard montre qu’il se trompe à hauteur de 46% quand on lui demande de vérifier une info !

Pourquoi ce masochisme ? Ce qui est bien avec Perplexity c’est justement qu’il est claqué au sol ! Exemple vécu : Sur une info concernant Zelensky (soi-disant achat de maison avec des fonds détournés pour faire un cadeau à sa maman), Perplexity m’a sorti côte à côte :

1. Que c’était vrai d’après (source « Canada.Pravda » – site de propagande russe).

2. Mais peut-être à nuancer (source « Factuel AFP » qui démentait entièrement l’info).

C’est probablement un des pires outils pour vérifier une information si vous avez le réflexe de déléguer complétement la réflexion à l’IA. Mais c’est génial pour exercer son esprit critique et éviter les effets de désapprentissage. En somme, à condition de bien comprendre les limites des outils IA pour s’informer, Perplexité vous incite à :

- Vérifier la crédibilité des sources affichées,

- Comparer les versions contradictoires,

- Faire le lien entre la source brute et le résumé de l’IA.

En bref, l’outil oblige à « activer » son esprit critique, nous expose à l’environnement médiatique d’une information particulière (incluant la désinformation) et en même temps nous fait gagner du temps dans l’identification des sources et les différents points de vue exprimés.

Le bilan : comment s’informer avec une IA ?

1. Vous être novice en vérification de l’info ?

L’IA peut vous être utile pour vous guider dans la méthode ou structurer votre recherche. Mais attention : ne lui déléguez jamais le verdict final. Elle est uniquement là pour vous guider sur des tâches spécifiques.

2. Vous savez déjà fact-checker/debunker ?

Actuellement, les méthodes classiques (Google Lens, InVid, croisement de sources) sont plus fiables, plus précises et consomment bien moins d’énergie. Néanmoins, dans l’environnement informationnel actuel, il est de plus en plus pertinent de comprendre comment fonctionne les outils IAg et de savoir les utiliser pour mieux comprendre les phénomènes de désinformation. En ce sens, si vous maîtrisez les outils pour vérifier une info, je recommande de « jouer » avec les IA pour s’informer.

3. Gardez votre autonomie intellectuelle

L’efficacité des IA évolue rapidement. À part certains qui passent beaucoup de temps à tester les mises à jour régulières, il est très difficile de suivre la cadence. Une IA qui serait fiable à 100% aujourd’hui peut très bien régresser 6 mois plus tard.

Pour moi, une bonne approche est d’apprendre à utiliser ces outils pour s’accompagner sur certaines étapes spécifiques. Le vrai danger n’est pas que l’IA se trompe, mais que vous finissiez par désapprendre à vérifier par vous-même.